Big Brother holder øje med dig

I en rapport fra den 1. oktober 2021 til De Grønne i Europa-Parlamentet “Biometrisk og adfærdsmæssig masseovervågning i EU’s medlemsstater” hedder det:

”Private og offentlige parter anvender i stigende grad “intelligente overvågningsløsninger”, herunder fjernidentifikation. Teknologier, der, hvis de ikke kontrolleres, kan udvikle sig til masseovervågning.”

Rapporten er forfattet af:

Dr. Francesco Ragazzi (videnskabelig koordinator), lektor i internationale relationer ved Leiden University (Holland), associeret forsker ved Centre d’Etude sur les Conflits, Liberté et Sécurité (Frankrig);

Dr. Elif Mendos Kuskonmaz, underviser ved School of Law ved University of Portsmouth;

Ildikó Z Plájás, post-doc forsker ved Institut for Statskundskab, Leiden Universitet;

Ruben van de Ven, ph.d.-kandidat i statskundskab ved Institut for Statskundskab, Leiden Universitet samt Dr. Ben Wagner, adjunkt ved Fakultetet for Teknologi, Politik og Ledelse ved TU Delft, hvor hans forskning fokuserer på teknologipolitik, menneskerettigheder og ansvarlige informationssystemer.

Hele rapporten finder du her: https://www.greens-efa.eu/biometricsurveillance/

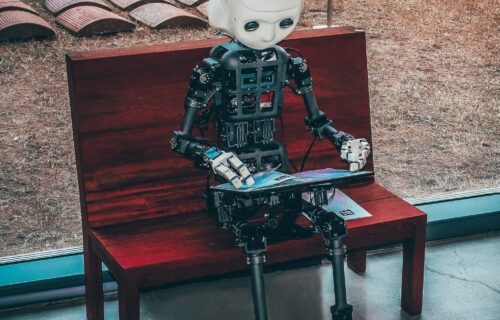

Foto: Jack Moreh, freerangestock.com.

Det uddybede resume af rapporten

KAPITEL 1: Introduktion

Formålet med rapporten er at skabe et problematiseret overblik over, hvad vi ved om, hvad der i øjeblikket bliver gjort i Europa, når det kommer til Remote Biometric Identification (RBI), samt at vurdere, i hvilke tilfælde vi potentielt kan falde ind i former for biometrisk masseovervågning.

Private og offentlige aktører implementerer i stigende grad “smarte overvågnings” løsninger, herunder RBI-teknologier, som, hvis de ikke kontrolleres, kan blive biometrisk masseovervågning.

Ansigtsgenkendelsesteknologi har været den mest diskuterede af RBI-teknologierne. Der synes dog at være ringe forståelse for, hvordan denne teknologi kan anvendes, og den potentielle indvirkning af en så bred vifte af applikationer på de europæiske borgeres grundlæggende rettigheder.

Autoritære regimers udvikling af RBI-systemer, som efterfølgende kan eksporteres til og bruges i Europa, giver anledning til bekymring. Ikke kun hvad angår udrulningen af sådanne teknologier, men også manglen på tilstrækkelig indsigt i privatlivets fredspraksis hos de virksomheder, der leverer systemerne.

Fire hovedpositioner er opstået blandt politiske aktører med hensyn til udbredelsen af RBI-teknologier og deres potentielle indvirkning på grundlæggende rettigheder:

1) aktiv fremme

2) støtte med sikkerhedsforanstaltninger;

3) moratorium og

4) direkte forbud.

KAPITEL 2: Teknisk oversigt

Det nuværende marked for RBI-systemer er overvældende domineret af billedbaserede produkter, hvis centrum er ansigtsgenkendelsesteknologi (FRT). Andre produkter såsom ansigtsgenkendelse og persongenkendelsesteknologier er også i brug.

FRT bliver typisk indsat til at udføre to typer søgninger: samarbejdssøgninger til verifikations- og/eller autentificeringsformål og ikke-samarbejdsvillige søgninger for at identificere en registreret. Førstnævnte involverer frivilligt samtykke fra den registrerede til at optage deres billede, mens sidstnævnte ikke må.

Live ansigtsgenkendelse er i øjeblikket den mest kontroversielle anvendelse af FRT: Live video-feeds bruges til at generere snapshots af individer og derefter matche dem med en database med kendte individer – “overvågningslisten”.

Andre RBI-teknologier bliver implementeret, selvom deres brug på nuværende tidspunkt er marginal sammenlignet med FRT, disse inkluderer blandt andet gang- (bevægelses-), lyd- og følelsesgenkendelsesteknologier.

En bedre forståelse af de tekniske komponenter og mulige anvendelser af billedbaserede RBI-teknologier er nødvendig for at vurdere deres potentielle politiske implikationer.

RBI-teknologier er underlagt tekniske udfordringer og begrænsninger, som bør overvejes i enhver bredere analyse af deres etiske, juridiske og politiske implikationer.

KAPITEL 3: Oversigt over implementeringer i Europa

Nuværende udrulninger af RBI-teknologier i Europa er primært eksperimentelle og lokaliserede. Teknologien eksisterer dog sideløbende med en bred vifte af algoritmisk behandling af sikkerhedsbilleder, der udføres på en skala, der spænder fra det individuelle niveau til, hvad der kunne klassificeres som biometrisk masseovervågning. At skelne mellem de forskellige karakteristika ved disse udrulninger er ikke kun vigtigt for at informere den offentlige debat, men hjælper også med at fokusere diskussionen på de mest problematiske anvendelser af teknologierne.

Billed- og lydbaserede sikkerhedsapplikationer, der bruges til autentificeringsformål, udgør i øjeblikket ikke en risiko for biometrisk masseovervågning. Det skal dog bemærkes, at en ændring af den retlige ramme kan øge risikoen for, at de bliver indsat til biometrisk masseovervågning, især da mange af de anvendte databaser indeholder millioner af registrerede.

Ud over autentificering bliver billed- og lydbaserede sikkerhedsapplikationer implementeret til overvågning. Overvågningsapplikationer omfatter udrulning af RBI i offentlige rum.

Fremskridt på to fronter gør udviklingen af biometrisk masseovervågning mere end en fjern mulighed. For det første den nuværende oprettelse og/eller opgradering af biometriske databaser, der anvendes i civil- og strafferegistre. For det andet den gentagne pilotering af live-feed-systemer forbundet med fjernbetjening af ansigts- og biometrisk informationssøgning og -genkendelsesalgoritmer.

KAPITEL 4: Retsgrundlag

Brugen af biometriske værktøjer til retshåndhævelsesformål i det offentlige rum rejser et centralt spørgsmål om den juridiske tilladelse i forhold til indsamling, opbevaring og behandling af data, når man overvejer individets grundlæggende rettigheder til privatlivets fred og beskyttelse af persondata. Set gennem denne linse kan RBI-teknologier have en alvorlig indvirkning på udøvelsen af en række grundlæggende rettigheder.

Indsættelsen af biometrisk overvågning i det offentlige rum skal være underlagt streng kontrol for at undgå omstændigheder, der kan føre til masseovervågning. Dette omfatter målrettet overvågning, som har potentialet til vilkårlig indsamling af data om alle personer, der er til stede på det overvågede sted, ikke kun om måldatasubjektets.

Den normative juridiske ramme for udførelse af biometrisk overvågning i offentlige rum kan findes i EU’s sekundære lovgivning om databeskyttelse (GDPR og LED). Brugen af biometriske data under denne ramme skal revideres i lyset af den beskyttelse, som de grundlæggende rettigheder giver.

Europa-Kommissionens forslag fra april 2021 om forordningen om loven om kunstig intelligens har til formål at harmonisere regulatoriske regler for medlemsstaterne om AI-baserede systemer. Den foreslåede forordning opstiller regler, der fokuserer på tre kategorier af risici (uacceptabel, høj og lav/minimal risiko) og forudser, at den dækker brugen af RBI-systemer. Det har også til formål at komplimentere reglerne og forpligtelserne i GDPR og LED.

KAPITEL 5: Politisk udvikling og vigtigste stridsspørgsmål

Fire hovedpositioner om RBI-systemer er opstået blandt politiske aktører som følge af både tekniske udviklinger på området og tidlig lovgivningsaktivitet i EU-institutionerne: 1) aktiv fremme 2) støtte med sikkerhedsforanstaltninger; 3) moratorium og 4) direkte forbud.

De, der går ind for støtte med sikkerhedsforanstaltninger, hævder, at implementeringen af RBI-teknologier bør overvåges strengt på grund af de potentielle risici, de udgør, herunder den potentielle fare for FRT, for eksempel for at bidrage til yderligere kriminalisering eller stigmatisering af grupper af mennesker, som allerede udsat for diskrimination.

Europa-Parlamentet vedtog en beslutning om kunstig intelligens i januar 2020, hvori de opfordrer Kommissionen “til at vurdere konsekvenserne af et moratorium for brugen af ansigtsgenkendelsessystemer”. Hvis det skønnes nødvendigt, kan et sådant moratorium påvirke nogle eksisterende anvendelser af FRT, herunder dets udbredelse i offentlige rum af offentlige myndigheder.

En række EU- og nationale NGO’er har opfordret til et direkte forbud mod brugen af RBI, og nogle hævder, at massebehandling af biometriske data fra offentlige rum skaber en alvorlig risiko for masseovervågning, der krænker grundlæggende rettigheder.

Europa-Kommissionens lovforslag til en lov om kunstig intelligens (EC 2021) er både et forslag til en reguleringsramme for kunstig intelligens og en revideret koordineret plan til støtte for innovation. Et træk ved loven er etableringen af risikoafhængige restriktioner, som vil gælde for de forskellige anvendelser af AI-systemer.

KAPITEL 6: Ansigtsgenkendelseskameraer i Bruxelles Internationale Lufthavn (Belgien)

Belgien er et af to europæiske lande, der endnu ikke har godkendt brugen af FRT, men retshåndhævelsen går stærkt ind for brugen, og de nuværende juridiske hindringer for implementeringen vil næppe holde ret længe.

I 2017, uden at det belgiske tilsynsorgan for politiinformation (COC) vidste det, anskaffede Bruxelles Internationale Lufthavn 4 kameraer forbundet til en ansigtsgenkendelsessoftware til brug for lufthavnspolitiet. Selvom COC efterfølgende afgjorde, at denne brug faldt uden for betingelserne for en lovlig indsættelse, faldt lovligheden af lufthavnseksperimentet ind i et juridisk gråt område på grund af de måder, hvorpå teknologien blev implementeret.

En begrundelse for lovligheden af lufthavnseksperimentet fra General Commissioner of Federal Police var at sammenligne den teknologiske udbredelse med den lovlige brug af andre intelligente teknologier såsom Automated Number Plate Recognition (ANPR). Selvom dette argument blev afvist på det tidspunkt, kunne et sådant system genindføres, hvis grunden til afbrydelse ikke længere er til stede i loven.

Der er en spirende civilsamfundsbevægelse i Belgien, der bestrider legitimiteten af biometrisk fjernidentifikation. Ændringerne af politiloven, der tillader politiets brug af realtids-smartkameraer i udførelsen af deres administrative og retslige opgaver, og de seneste erklæringer fra indenrigsministeren synes dog at pege i retning af mere accept af biometrisk fjernovervågning.

KAPITEL 7: Det indbrudsfrie kvarter i Rotterdam (Holland)

Fieldlab Indbrudsfrit Nabolag er et offentligt-privat samarbejde med to formål: at opdage mistænkelig adfærd og at påvirke den mistænktes adfærd. Mens systemet med smarte gadelygter indsamler nogle billed- og lydbaserede data, registrerer det ikke nogen egenskaber, der er specifikke for den enkelte.

Fra et juridisk perspektiv er der et spørgsmål om, hvorvidt de data, der behandles af programmet Indbrudsfrit Nabolag, kvalificerer som persondata og dermed vil falde inden for databeskyttelseslovgivningens anvendelsesområde.

Det er anfægtet, om former for digital overvågning og signalering faktisk er de mest effektive metoder til at forhindre indbrud. På trods af programmets formål er gadelygterne indtil nu kun blevet brugt til at fange data med henblik på maskinlæring.

Den infrastruktur, der er installeret til forsøgene, kan potentielt bruges til mere invasive former for overvågning. Under projektet har det lokale politi f.eks. allerede udtrykt interesse for adgang til kameraerne.

I marts 2021 sluttede Fieldlab-forsøget. De data, der blev indsamlet i løbet af projektet, var ikke tilstrækkelige nok til, at computeren kunne skelne mistænkelige baner. Infrastrukturen af kameraer og mikrofoner er i øjeblikket deaktiveret, men forbliver på plads.

KAPITEL 8: Safe City-projekterne i Nice (Frankrig)

Flere franske byer har lanceret “sikker by” projekter, der involverer biometriske teknologier, men Nice er uden tvivl den nationale frontløber. Byen har i øjeblikket den højeste CCTV-dækning af enhver by i Frankrig og har mere end dobbelt så mange politiagenter pr. indbygger i nabobyen Marseille.

Gennem en række offentlig-private partnerskaber begyndte byen en række initiativer ved hjælp af RBI-teknologier (inklusive følelser og ansigtsgenkendelse). Disse teknologier blev indsat til både autentificerings- og overvågningsformål, hvor nogle falder ind under kategorien biometrisk masseovervågning.

Et projekt, der brugte FRT på en gymnasieskole i Nice og et i Marseille, blev til sidst erklæret ulovligt. Retten fastslog, at det påkrævede samtykke ikke kunne opnås på grund af magtubalancen mellem den målrettede offentlighed (studerende) og den offentlige myndighed (den offentlige uddannelsesinstitution). Denne sag fremhæver vigtige spørgsmål om udbredelsen af biometriske teknologier i offentlige rum.

Brugen af biometrisk masseovervågning af Nices borgmester Christian Estrosi har bragt ham på kollisionskurs med den franske databeskyttelsesmyndighed (CNIL) samt menneskerettigheds-/digitale rettighedsorganisationer (Ligue des Droits de l’Homme, La Quadrature du Net). Hans aktiviteter har rejst både bekymring og kritik over brugen af teknologierne og deres potentielle indvirkning på privatlivets fred for personlige data.

KAPITEL 9: Ansigtsgenkendelse i Südkreuz Berlin, Hamburg G20 og Mannheim (Tyskland)

Det tyske forbundspoliti gennemførte i samarbejde med det tyske jernbaneselskab et projekt kaldet “Sicherheitsbahnhof” på Berlins banegård Südkreuz i 2017/18, som omfattede 77 videokameraer og et videostyringssystem.

Politiet i Hamborg brugte ansigtsgenkendelsessoftware Videmo 360 under protesterne mod G20-topmødet i 2017. Databasen omfatter 100.000 personer i Hamborg under G20-topmødet, og hvis profiler er gemt i politiets database. Teknologien giver mulighed for bestemmelse af adfærd, deltagelse i forsamlinger, præferencer og religiøst eller politisk engagement.

68 kameraer blev installeret af det lokale politi på centrale pladser og steder i den tyske by Mannheim for at registrere bevægelsesmønstre for mennesker. I dette projekt, der startede i 2018, bruges softwaren til at detektere iøjnefaldende adfærd.

Halvdelen af disse implementeringer (Mannheim & Berlin Südkreuz) fandt sted som foranstaltninger til at teste effektiviteten af software til ansigtsgenkendelse og adfærdsanalyse. Denne “retfærdiggørelse som en test” tilgang bruges ofte i Tyskland til at argumentere for en afvigelse fra eksisterende regler og samfundsmæssige forventninger og blev på samme måde anvendt under afvigelser til fælles aftalte foranstaltninger under Coronavirus/COVID-19-pandemien.

Modstand mod videoovervågning er heller ikke i ringe del et resultat af konstant kampagne og protest fra det tyske civilsamfund. Chaos Computer Club og Digital Courage har konsekvent kæmpet mod videoovervågning og enhver form for biometrisk eller adfærdsmæssig overvågning. Den langsigtede effekt af disse “piloter” er at normalisere overvågningen.

KAPITEL 10: Dragonfly-projektet (Ungarn)

Den ungarske regering ledet af premierminister Viktor Orbán har længe været på kollisionskurs med EU-institutionerne over retsstaten og undermineringen af landets retslige uafhængighed og demokratiske institutioner.

Ungarn er en frontløber i Europa, når det kommer til at godkende retshåndhævende myndigheders brug af ansigtsgenkendelsesteknologi, udvikle en landsdækkende og centraliseret database (The Dragonfly Project) og bruge Home Quarantine App som en del af regeringens Coronavirus-foranstaltninger.

Infrastrukturen er på plads, hvilket potentielt muliggør en centraliseret udrulning af biometriske masseovervågningsteknologier i Ungarn, og har nået et hidtil uset omfang, mens den juridiske og etiske undersøgelse af disse teknologier halter faretruende bagefter.

Dette skyldes (1) overlapningen mellem den private og offentlige sektor, specifikt statslige institutioner, og (2) de komplekse forviklinger biometriske systemer har med andre informationssystemer (såsom bilregistre, trafikstyring, offentlig transportovervågning og overvågning mv.).

Selvom sidstnævnte ikke er bekymret for sporene af den menneskelige krop, kan de ikke desto mindre bruges til og lette biometrisk masseovervågning. Disse forviklinger skaber gråzoner af biometrisk masseovervågning, hvor udviklingen og implementeringen af sådanne teknologier er skjult for synlighed og kritisk granskning.

Dragonfly-projektet har fremkaldt adskillige advarsler vedrørende databeskyttelse og retten til privatliv fra både offentlige og private organisationer. Imidlertid er manglen på anfægtelse og social debat omkring spørgsmål om privatliv og menneskerettigheder i forbindelse med sådanne projekter som den ungarske regerings Dragonfly slående.

KAPITEL 11: Anbefalinger

1. EU bør forbyde udbredelsen af både vilkårlige og “målrettede” teknologier til fjernbiometrisk og adfærdsmæssig identifikation (RBI) i offentlige rum (real-time RBI) såvel som efterfølgende identifikation (eller retsmedicinsk RBI). Vores analyse viser, at begge praksisser, selv når de bruges til “målrettet overvågning”, svarer til masseovervågning.

I overensstemmelse med lignende anbefalinger fra EDPB og EDPS (1) bør EU forbyde anvendelsen af fjernteknologier til biometri og adfærdsidentifikation i offentlige rum.

I tråd med EDRi’s holdning vedrørende EU’s lov om kunstig intelligens (2), understøtter vores forskning ideen om, at sondringen mellem “realtid” og “efterfølgende” er irrelevant, når det kommer til disse teknologiers indvirkning på grundlæggende rettigheder. Efter identifikation indebærer faktisk et højere skadepotentiale, da flere data kan samles fra forskellige kilder for at fortsætte til identifikation. Brugen af sådanne teknologier til “målrettet overvågning” er således lige så skadelig, som praksis kan betragtes som ekspansiv og indgribende i et omfang, så det ville udgøre uforholdsmæssigt indgreb i retten til privatliv og beskyttelse af personoplysninger.

Dette vedrører ikke kun erhvervelse og behandling af ansigter, men også gang, stemme og andre biometriske eller adfærdsmæssige signaler.

2. EU bør styrke gennemsigtigheden og ansvarligheden af biometriske og adfærdsmæssige genkendelsesteknologier

Vores forskning viste, at størstedelen af overvågningssystemerne forbliver uigennemsigtige. Der er meget få oplysninger om, hvordan borgernes data behandles, når de træder ind i overvågede offentlige rum. Der gives sjældent konkrete alternativer, hvis de ikke ønsker at blive overvåget. I nogle ekstreme tilfælde, såsom indsættelsen af FRT-retssager i London, blev borgere, der bevidst undgik overvågning ved at tildække deres ansigter, udsat for bøder. Dette udgør betydelige udfordringer for borgernes rettigheder såvel som for disse systemers gennemsigtighed og ansvarlighed.

Det synes derfor nødvendigt at udvide de eksisterende krav til gennemsigtighed og ansvarlighed i den nye EU-lov om kunstig intelligens for biometriske teknologier. Disse krav bør udvides til at omfatte ekstern uafhængig ansvarlighed, gennemsigtighed og tilsyn for enhver implementering af biometriske teknologier, som ikke allerede er forbudt i henhold til loven.

Det synes især bydende nødvendigt at øge gennemsigtigheden af sådanne systemer ved at betinge deres drift til offentliggørelse af nøglekarakteristika og funktioner (type af dataindsamling, type maskinlæringsalgoritme, arten af data indsamlet i databasen), der er nødvendige for en effektiv offentlighed tilsyn med deres drift. Disse detaljer bør offentliggøres, selv når indsættelser bruges til national sikkerhed eller retshåndhævelsesformål, og offentligheden bør informeres om planlagte og igangværende projekter.

3. EU bør fremme styrkelsen af robuste ansvarlighedsmekanismer for biometriske overvågningssystemer.

Den nuværende lovgivningsramme er stadig uklar med hensyn til, hvilke institutioner der kan revidere eller godkende biometriske overvågningssystemer. I lyset af GDPR og LED håndhæver databeskyttelsesmyndighederne (DPA’erne) i nogle medlemslande den relevante databeskyttelseslovgivning og fører tilsyn med behandlingen af biometriske data, mens en separat myndighed i andre har til opgave at gennemgå kompatibiliteten med den relevante lovgivning for så vidt angår behandling af personoplysninger hos retshåndhævende myndigheder (såsom Belgien, se casestudie).

EU bør arbejde hen imod at udvikle en centraliseret godkendelsesproces for biometrisk overvågning, hvor alle relevante myndigheder er inkluderet og kan nedlægge veto mod godkendelsen.

Selvom den foreslåede EU-lov om kunstig intelligens begrænser en forhåndsgodkendelse fra en domstol eller uafhængig administrativ myndighed til “realtids” biometrisk overvågning, er det nødvendigt at understrege, at efterfølgende biometriske identifikationssystemer skal være underlagt tilsyn eller godkendelse under hensyntagen til standarder under EMRK og chartret.

4. EU bør fremme individuelle rettigheder i henhold til GDPR gennem fremme af digitale rettigheder-by-design-teknologier.

Der kunne lægges mere vægt på at beskytte individers rettigheder i henhold til GDPR, når det kommer til dataindsamling og -behandlingsmekanismer samt en vurdering af grundlæggende rettigheder forud og efterfølgende.

Dette kunne implementeres teknisk gennem dataminimering eller digitale rights-by-design-metoder, enten gennem tekniske løsninger, der ikke indsamler biometriske oplysninger, eller systemer, der inkorporerer automatiserede former for underretning, uforanderlig gennemsigtighed og logning af ansvarlighed og kontrol af data eller ideelt set en kombination af begge tilgange.

5. EU bør sikre effektiv håndhævelse af GDPR-formålsbegrænsning.

Formålsbegrænsning er et af hovedprincipperne i GDPR. Som vores rapport viser, holdes omlægningen af biometriske data ikke altid tilstrækkeligt i skak.

Fra et teknisk perspektiv kan biometrisk masseovervågning nemt opstå ved at forbinde forskellige elementer af en teknisk infrastruktur (videooptagelseskapacitet, behandlingsalgoritmer, biometriske datasæt) udviklet i andre sammenhænge.

For eksempel, mens retsmedicinsk brug af ansigtsgenkendelse ikke er en form for biometrisk fjernidentifikation i sig selv, har vedtagelsen af sådanne systemer gjort det muligt at oprette biometrisk søgbare nationale datasæt. Disse datasæt er en del af en potentiel biometrisk masseovervågningsinfrastruktur, som kan blive en teknisk realitet, hvis live kamerafeeds, behandlet gennem live ansigtsgenkendelsessoftware, er forbundet til dem.

For at opretholde et demokratisk tilsyn med anvendelsen af infrastrukturen og undgå risikoen for funktionskryb (dvs. når en teknologi bliver brugt ud over dets oprindelige formål) er det således bydende nødvendigt, at princippet om formålsbegrænsning systematisk håndhæves og strengt reguleres med med hensyn til typen af data (kriminelle eller civile datasæt, datasæt genereret fra sociale medier, som i Clearview AI-kontroversen), mod hvilke der kan udføres biometriske søgninger.

6. EU bør støtte stemmer og organisationer, der er mobiliseret til respekt for EU’s grundlæggende rettigheder

Endelig viste vores forskning, ud over statslige tilsynsagenturer, at mange institutioner fra civilsamfundet er aktive i at sikre, at EU’s grundlæggende rettigheder respekteres inden for biometriske sikkerhedsteknologier.

Mens de i nogle lande nyder godt af et tæt netværk af civilsamfundsfinansiering, er de i andre udsat for streng kontrol og økonomiske restriktioner (se f.eks. Ungarns casestudie i denne rapport).

At støtte civilsamfundsorganisationer, der opererer i sektoren for digitale rettigheder, er derfor medvirkende til en sund demokratisk debat og tilsyn. Civilsamfundet skal være i stand til at deltage i alle relevante lovgivningsmæssige og andre beslutningsprocedurer.

Især på området retssager kunne støtte til civilsamfundet og EU-borgeres adgang til rettigheder være yderst nyttig. Vi har fundet adskillige områder i vores undersøgelse, hvor tilstrækkelig juridisk klarhed manglede og sandsynligvis kun ville finde sted gennem domstolene. Vi vil derfor råde EU til at støtte eksisterende retssager om digitale rettigheder og skabe yderligere mekanismer til at understøtte denne tilgang.

7. EU bør tage hensyn til den globale dimension af industrien for biometrisk og adfærdsanalyseteknologi

De teknologier, der bruges til FRT i Europa, kommer fra leverandører over hele verden. Teknologier til biometrisk eller adfærdsanalyse testes ofte i ét land, før de implementeres i et andet.

EU’s politik for teknologiindustrien for biometri eller adfærdsanalyse skal derfor overveje dens indvirkning både i og uden for Europa. Her kan den nyligt reviderede EU-eksportkontrolramme, som kan omfatte biometriske og adfærdsmæssige teknologier, spille en rolle.

Noter:

1) https://edps.europa.eu/press-publications/press-news/press-releases/2021/edpb-edps-call-ban-use-ai-automated-recognition_en

2) https://edri.org/wp-content/uploads/2021/08/European-Digital-Rights-EDRi-submission-to-European-Commission-adoption-consultation-on-the-Artificial-Intelligence-Act-August-2021.pdf

Se mere her:

Internet of Bodies og dig: https://nejtil5g.dk/internet-of-bodies/internet-of-bodies-iob-og-dig/

Internet of Bodies: https://nejtil5g.dk/dokumenter/internet-of-bodies-iob/

AI generede ansigter: https://nejtil5g.dk/ai/ai-genererede-ansigter/

FE’s og PET’s hemmeligheder: https://nejtil5g.dk/elektronikken-som-vaaben/fes-og-pets-hemmeligheder/

Overvågning og 5G: https://nejtil5g.dk/dokumenter/overvaagning-og-5g/

Pingback: Overvågning og 5G - nejtil5g.dk

Pingback: Overvågning - nejtil5g.dk

Pingback: World Economic Forums totalitære rædselsvision - nejtil5g.dk

Pingback: IT sikkerhed og 5G - nejtil5g.dk

Pingback: SMART politik - del 1 - nejtil5g.dk

Pingback: SMART politik - del 2 - nejtil5g.dk

Pingback: Digital skam - nejtil5g.dk

Pingback: IT sikkerhed og 5G - nejtil5g.dk

Pingback: Det officielle Danmark - nejtil5g.dk

Pingback: Reelle trusler og muligheder fra den virtuelle verden - nejtil5g.dk

Pingback: EU og den digitale udvikling - nejtil5g.dk

Pingback: De ændrede vores opfattelse af IT-sikkerhed for evigt - nejtil5g.dk

Pingback: Skal kunstig intelligens erstatte de demokratiske processer? - nejtil5g.dk

Pingback: 15-minutters byer er lig med mere overvågning og kontrol - nejtil5g.dk

Pingback: Organiseret elektronisk stalking: Du tror det er løgn – intet mindre - nejtil5g.dk

Pingback: Digital Stalking - nejtil5g.dk

Pingback: Kunstig intelligens - AI - nejtil5g.dk

Pingback: AI-generatorer er ikke 'hallucinerende'. Men det er deres skabere - nejtil5g.dk

Pingback: Overvågning og 5G - nejtil5g.dk